今天这篇教案,就带大家从零基础入门,一步步搭建属于自己的ComfyUI基础工作流,全程实操、无多余理论,新手跟着做就能上手,做完就能直接用于AI短视频素材生成,适配Midjourney、Stable Diffusion联动使用,为后续剪辑、成片打下基础。

先跟大家说下重点:这篇教案不是单纯讲理论,而是结合我们课程中新手最常遇到的问题(比如角色形象不一致、出图效率低、参数设置混乱),针对性拆解操作,每一步都标注了注意事项,都是我在教学中总结的实战经验,新手避开这些坑,能少走很多弯路。

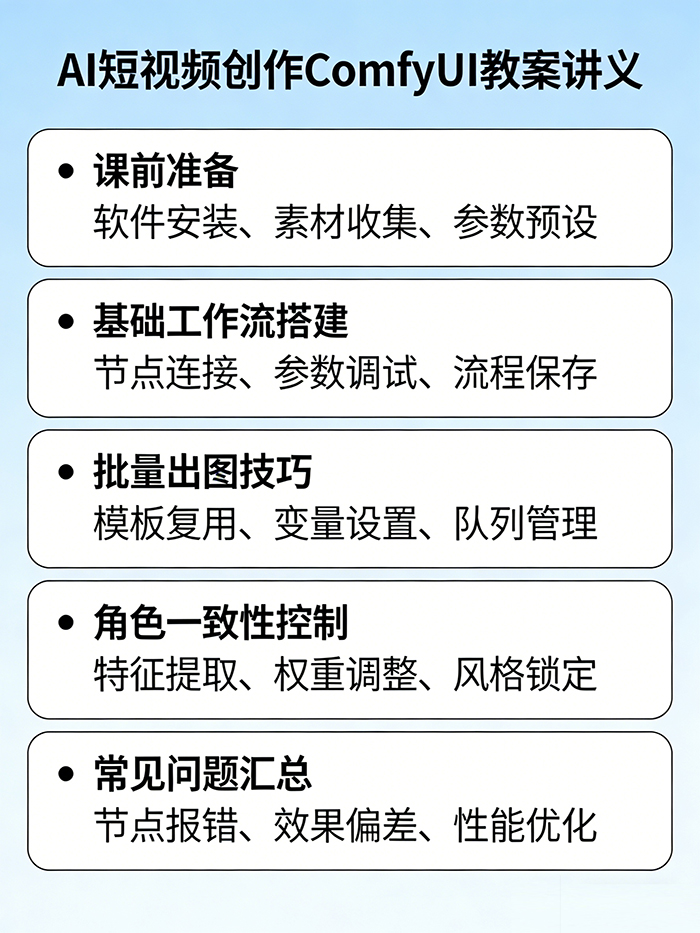

作为AI短视频、漫剧创作的核心工具,ComfyUI的节点工作流能让我们实现批量出图、角色一致性控制,大幅提升创作效率——这也是我们28天AI短视频与漫剧制作课程中,第1周就重点讲解的核心技能。很多新手刚接触ComfyUI时,会被复杂的节点和参数吓住,觉得比Stable Diffusion难上手,但只要掌握了核心逻辑,你会发现它能解决SD很多“不方便”的问题,尤其适合需要批量生产素材的短视频、漫剧创作。

一、课前准备:ComfyUI安装与环境检查(新手必看)

在搭建工作流之前,先确保你的ComfyUI安装到位,环境配置无误——这是很多新手第一步就卡壳的地方,这里给大家明确步骤和检查要点,和我们课程里的实操步骤完全一致,跟着来就不会错。

1. 必备安装包与环境要求

首先明确,ComfyUI不需要复杂的代码操作,新手也能轻松安装,核心要求如下(适配Windows系统,Mac系统操作类似,后续会补充差异点):

- 电脑配置:至少8G内存,独立显卡(显存4G以上最佳,不然批量出图会卡顿);

- 必备工具:ComfyUI安装包(官网直接下载,建议下载最新版本,兼容更多模型)、Stable Diffusion基础模型(推荐Realistic Vision、AnyLoRA,适配短视频写实、卡通风格);

- 辅助工具:解压软件(用于解压安装包)、模型管理器(可选,方便后续切换模型,新手可先不装)。

2. 安装步骤与常见问题解决

安装步骤很简单,3步就能完成,重点说下新手容易出错的地方:

- 下载ComfyUI安装包后,解压到电脑非C盘(避免占用系统内存,导致后续出图卡顿),解压后找到“run_nvidia_gpu.bat”文件,双击运行;

- 首次运行会自动下载依赖包,这个过程可能需要5-10分钟,耐心等待,不要中途关闭窗口;

- 运行成功后,会自动弹出浏览器窗口,显示ComfyUI的操作界面,此时安装完成。

常见问题排查(新手必记):

- 双击运行后无反应:检查显卡是否支持,显存是否足够,若显存不足,可先关闭其他占用内存的软件,再重新运行;

- 浏览器无法弹出:手动打开浏览器,输入地址“http://127.0.0.1:8188/”,即可进入操作界面;

- 依赖包下载失败:检查网络,若网络正常仍失败,可手动下载依赖包(官网有详细教程),复制到对应文件夹即可。

3. 界面认知:新手必懂的3个核心区域

打开ComfyUI后,不要急于搭建工作流,先熟悉界面布局,这是后续操作的基础,我们课程里会让学员反复熟悉这3个区域,避免后续操作混乱:

- 左侧:节点区,包含所有可使用的节点(提示词、采样、模型、输出等),新手前期重点关注“Load Checkpoint(加载模型)”“CLIP Text Encode(提示词编码)”“KSampler(采样)”“Save Image(保存图片)”这4个核心节点;

- 中间:工作区,用于拖拽节点、连接节点,搭建工作流的核心区域,新手可先清空默认工作流,从头开始搭建;

- 右侧:参数区,选中某个节点后,这里会显示该节点的可调整参数,后续我们会重点讲解核心参数的设置方法。

二、核心实操:搭建第一个ComfyUI基础工作流(短视频素材专用)

这部分是重点,也是我们课程第4天的核心实操内容,新手跟着步骤一步步来,就能搭建出可直接用于AI短视频素材生成的工作流,重点解决“角色一致性”和“批量出图”两个核心需求——这两个需求是AI短视频、漫剧创作中最常用的,比如制作系列短视频,需要保证主角形象统一,批量出图能节省大量时间。

步骤1:加载模型(基础核心步骤)

模型是出图的基础,不同模型对应不同风格,短视频创作中,我们常用写实、卡通两种风格,这里以卡通风格为例(适配漫剧、卡通类短视频):

- 从左侧节点区,找到“Load Checkpoint”节点,拖拽到中间工作区;

- 选中该节点,在右侧参数区,点击“Checkpoint”下拉框,选择我们提前安装好的卡通模型(比如AnyLoRA);

- 参数设置:“vae”选择对应模型的vae文件(一般和模型同名,无需手动修改,默认即可),“model”和“clip”会自动匹配,无需调整。

注意:新手不要频繁切换模型,先熟练掌握一个模型的参数设置,再尝试其他模型,避免参数混乱导致出图效果不佳。

步骤2:添加提示词节点(控制出图内容)

提示词是控制出图内容的关键,和Midjourney、Stable Diffusion的提示词逻辑一致,但ComfyUI需要将正向提示词和负向提示词分开设置,这也是新手容易出错的地方:

- 从左侧节点区,找到“CLIP Text Encode”节点,拖拽两个到工作区(一个用于正向提示词,一个用于负向提示词);

- 选中第一个CLIP Text Encode节点(正向提示词),在右侧参数区的“text”框中,输入短视频素材需要的内容,比如“卡通女孩,扎双马尾,穿着校服,微笑,背景是教室,高清,细节丰富”(提示词要具体,避免模糊,这是我们课程里强调的Prompt工程技巧);

- 选中第二个CLIP Text Encode节点(负向提示词),输入需要避免的内容,比如“模糊,畸形,低画质,杂乱背景,错别字”(负向提示词能优化出图质量,新手一定要加上);

- 连接节点:将“Load Checkpoint”节点的“clip”输出端,分别连接到两个“CLIP Text Encode”节点的“clip”输入端(鼠标点击输出端,拖拽到输入端即可完成连接,连接错误会显示红色,新手可多尝试)。

步骤3:添加采样节点(控制出图质量)

采样节点是控制出图质量和速度的核心,短视频素材不需要过度追求高清(避免文件过大,后续剪辑卡顿),重点保证出图清晰、速度快,参数设置如下(新手直接套用即可,这是我们教学中总结的最优参数):

- 从左侧节点区,找到“KSampler”节点,拖拽到工作区;

- 连接节点:将“Load Checkpoint”节点的“model”输出端,连接到“KSampler”节点的“model”输入端;将两个“CLIP Text Encode”节点的“conditioning”输出端,分别连接到“KSampler”节点的“positive”(正向)和“negative”(负向)输入端;

- 参数设置(重点):

- sampler_name:选择“euler_a”(新手首选,出图速度快,质量稳定,适合批量出图);

- scheduler:选择“normal”(默认即可,无需修改);

- steps:设置为20-25步(步数越多,出图越清晰,但速度越慢,短视频素材20步足够);

- cfg:设置为7.0(控制提示词的影响力,过高会导致画面畸形,过低会偏离提示词,7.0是最优值);

- width/height:设置为1080×1920(竖屏,适配抖音、快手等短视频平台,横屏可设置为1920×1080);

- seed:设置为-1(随机种子,每次出图不同;若想生成相同形象的角色,可固定一个数字,比如123456,这是控制角色一致性的关键技巧)。

步骤4:添加输出节点(保存图片)

最后一步,添加保存节点,将生成的图片保存到电脑,方便后续剪辑使用,操作很简单:

- 从左侧节点区,找到“Save Image”节点,拖拽到工作区;

- 连接节点:将“KSampler”节点的“image”输出端,连接到“Save Image”节点的“image”输入端;

- 参数设置:在右侧参数区的“filename_prefix”框中,输入图片前缀,比如“short-video-material”(方便后续查找),“output_directory”可设置为电脑指定文件夹(默认是ComfyUI的output文件夹,也可手动修改)。

步骤5:运行工作流,查看出图效果

所有节点连接完成后,点击工作区右上角的“Queue Prompt”按钮,即可开始运行工作流,出图时间根据电脑配置而定,一般10-30秒即可完成。

出图后,可在设置的输出文件夹中找到图片,查看效果:若不符合预期,可调整提示词(比如增加细节描述)、采样步数或cfg参数,重新运行即可;若效果满意,就可以批量生成素材了。

三、新手进阶:批量出图与角色一致性技巧(课程重点)

学会基础工作流后,我们需要提升效率,解决AI短视频、漫剧创作中“批量出图”和“角色一致性”的核心需求——这也是ComfyUI比SD更适合短视频创作的关键,下面两个技巧,是我们课程中重点讲解的,新手掌握后,能大幅提升创作效率。

技巧1:批量出图设置(适合批量生成短视频素材)

短视频创作中,我们经常需要生成多组不同姿态、不同场景的素材,手动多次运行工作流很麻烦,批量出图设置能一次性生成多组素材,操作如下:

- 在“KSampler”节点中,找到“batch_size”参数,设置为3-5(根据电脑配置调整,配置越高,可设置越大,建议新手先设置为3);

- 在“Save Image”节点中,勾选“filename_prefix”右侧的“append_index”(自动给图片编号,避免覆盖);

- 点击“Queue Prompt”按钮,即可一次性生成3-5张不同的图片,且风格、角色形象保持一致(前提是seed固定)。

注意:批量出图时,电脑内存占用会增加,若出现卡顿,可降低“batch_size”参数,关闭其他占用内存的软件。

技巧2:角色一致性控制(漫剧、系列短视频必备)

制作漫剧或系列短视频时,需要保证主角形象统一(比如同一角色的五官、发型、服饰不变),很多新手用SD生成时,容易出现角色“变脸”的问题,ComfyUI通过以下两个技巧,就能轻松解决:

- 固定seed值:在“KSampler”节点中,将seed设置为一个固定数字(比如123456),每次生成图片时,seed不变,角色的基础形象就不会变;

- 添加参考图节点:从左侧节点区找到“Load Image”节点(加载参考图),拖拽到工作区,将参考图(比如主角的基础形象图)加载进来,然后将“Load Image”节点的“image”输出端,连接到“KSampler”节点的“image”输入端(作为参考),这样生成的角色,会和参考图的形象保持一致,同时可调整姿态、场景。

补充:参考图建议选择高清、正面的图片,这样生成的角色一致性更好,这是我们在教学中,针对新手容易出现的“角色跑偏”问题,总结的实用技巧。

四、常见问题汇总(新手避坑指南)

结合我们课程中,新手在学习ComfyUI时最常遇到的问题,汇总如下,每个问题都给出了具体的解决方法,新手遇到问题时,可直接对照查找,不用再反复试错:

- 问题1:节点连接后,运行时显示红色错误?

- 解决方法:检查节点连接是否正确,重点查看“Load Checkpoint”节点的“clip”“model”输出端,是否分别连接到对应节点的输入端;若连接正确,重启ComfyUI即可。

- 问题2:生成的图片模糊、细节不足?

- 解决方法:提高采样步数(调整到25-30步),增加提示词中的细节描述(比如“高清,4K,细节丰富,发丝清晰”),同时检查模型是否适配,避免用写实模型生成卡通风格。

- 问题3:批量出图时,电脑卡顿、崩溃?

- 解决方法:降低“batch_size”参数(设置为2-3),关闭其他占用内存的软件,若仍卡顿,可降低图片分辨率(比如720×1280)。

- 问题4:角色一致性差,每次出图形象都不一样?

- 解决方法:固定seed值,添加参考图节点,同时在提示词中,明确描述角色的核心特征(比如“扎双马尾,圆脸蛋,穿着蓝色校服,戴眼镜”),避免提示词模糊。

五、课后实操任务(巩固练习)

结合我们28天课程的实战要求,给大家布置一个课后实操任务,新手完成这个任务,就能熟练掌握ComfyUI基础工作流,直接用于后续短视频素材生成:

- 搭建基础工作流,选择卡通模型,生成3张“卡通男孩,穿着运动服,在操场跑步”的竖屏素材(分辨率1080×1920);

- 设置批量出图,一次性生成5张素材,确保角色形象一致(固定seed值);

- 尝试添加参考图节点,加载一张卡通男孩图片,生成和参考图形象一致、不同姿态的素材;

- 将生成的素材保存到指定文件夹,后续我们会讲解如何将这些素材导入剪映,进行短视频剪辑。

总结

ComfyUI作为AI短视频、漫剧创作的核心工具,核心优势在于“灵活、高效、可控制”,新手不用害怕复杂的节点,只要掌握“加载模型→添加提示词→采样→输出”这4个核心步骤,再结合批量出图、角色一致性的技巧,就能快速上手。

后续我们还会讲解ComfyUI与Midjourney、Stable Diffusion的联动使用,以及更复杂的工作流搭建(比如动态漫素材生成),帮助大家进一步提升创作效率,抢占AI短视频、漫剧的创作风口。

如果在实操过程中遇到问题,可对照文中的常见问题解决,如果想深入学习的也可以了解一下AI短视频与漫剧课程,也可以留言交流,我会结合教学经验,给大家针对性的指导——毕竟,AI创作的核心是实操,多练、多调整,才能快速掌握技巧,真正把工具用起来,产出高质量的短视频、漫剧素材。